Cloudflare构建了面向LLM的高性能基础设施

点击查看原文>

Cloudflare 最近发布了全新的基础设施,可以在其全球边缘网络上运行大型的 AI 大语言模型。由于这类模型依赖昂贵的硬件,并且需要处理海量的输入和输出文本数据,Cloudflare 将模型输入处理与输出生成拆分到不同的专用优化系统中,并自研推理引擎实现 GPU 资源的更高效调度。

Cloudflare 团队表示,其中的一个核心优化是把模型推理拆分为两个阶段,由不同服务器分别进行处理,一个阶段负责读取并预处理输入文本,另一阶段专注生成输出内容。Cloudflare 首席产品经理Michelle Chen、高级工程经理Kevin Flansburg和首席系统工程师Vlad Krasnov撰文指出:

我们用来提升性能与资源效率的硬件架构叫做解耦预填充(disaggregated prefill)。LLM 请求处理分为两个阶段,预填充阶段处理输入 Token 并填充 KV 缓存,解码阶段逐一生成输出 Token。预填充通常属于计算密集型负载,而解码则是内存密集型负载。

Cloudflare 还自研了名为Infire的 AI 推理引擎。该引擎在 2025 年 Cloudflare 周年庆活动期间正式发布,它可以跨多 GPU 更高效地运行大语言模型,降低内存占用、缩短模型启动时间,最终实现更低的响应延迟。

像 Kimi K2.5 这类大语言模型体量极其庞大(参数规模超万亿、模型大小约 560GB),必须拆分部署到多块 GPU 上,仅加载模型到内存就至少需要 8 块 H100 显卡,这还未计入推理过程额外占用的内存开销。当谈及 Infire 引擎与硬件优化为何能高效支撑超大规模的模型、并为用户提供更快的响应时,Chen、Flansburg 和 Krasnov 补充说:

在流水线并行方面,Infire 会对流水线所有阶段做合理的负载均衡,避免某一阶段 GPU 空闲等待而其他阶段满载执行的资源饥饿问题。在张量(tensor)并行方面,Infire 以减少 GPU 间通信开销为优化目标,尽可能提升通信效率。对绝大多数模型而言,流水线并行与张量并行结合使用,就能在吞吐量和延迟之间取得最优平衡。

Cloudflare 此前曾发文介绍如何在自己的AI推理平台部署开源模型,率先在 Workers AI 上线了 Moonshot AI 的 Kimi K2.5 模型,并透露团队正在采用多样化的硬件配置,适配各类大模型的最优运行需求。

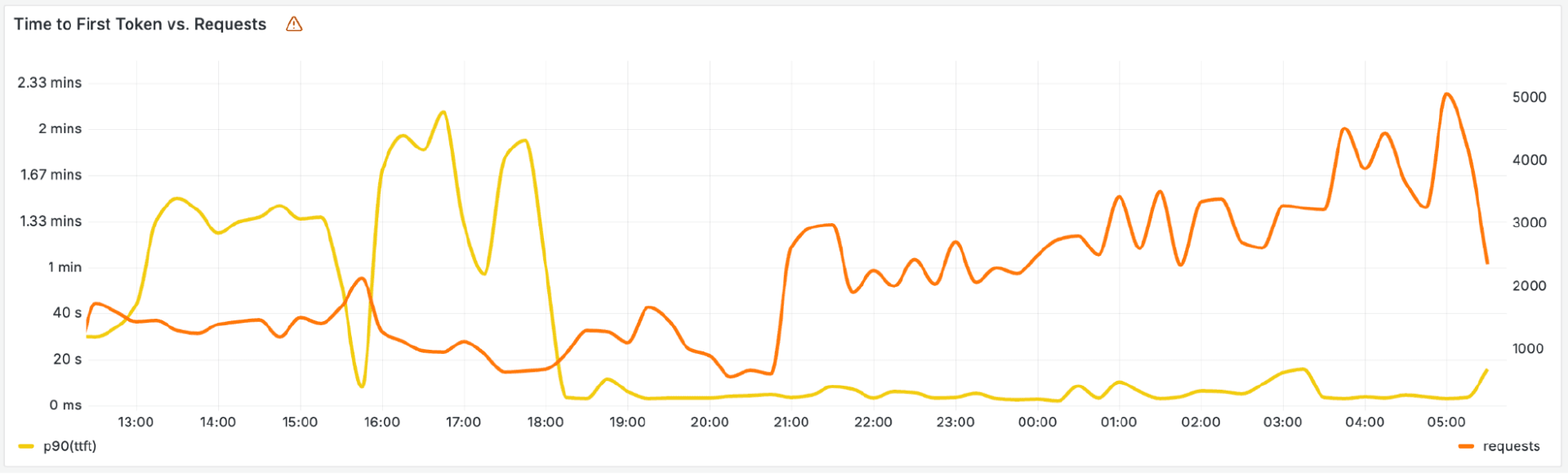

图片来源:Cloudflare 的博客文章

Cloudflare 表示,团队进一步对 Infire 做了内存优化,缩减内部流程的 GPU 内存开销,如今仅需 2 块 H200 GPU 即可运行 Llama 4 Scout,并且仍留有充足容量支撑上下文 Token,8 块 H100GPU 便可运行 Kimi K2.5,同时预留出足够内存用于 KV 缓存。

Cloudflare 近期还推出了Unweight模型压缩系统,官方称可在无损精度的前提下,将大语言模型权重压缩了 15%–22%,减少推理时 GPU 加载与传输的数据量,让模型运行更快、资源效率更高。

并不是只有 Cloudflare 在关注大模型生产落地方面的基础设施挑战。Cockroach Labs最新“AI基础设施现状”报告指出,随着企业将 AI 系统投入日常业务,大量企业发现现有基础设施无法承载 AI 负载所需的规模与可靠性要求:

传统基础设施围绕间歇性的人机交互而设计,无法承受 AI 这种高压力的负载。想要适配 AI 业务的高并发与不可预测性,企业不能只做性能升级,更需要从系统架构层面进行根本性的重构。

Cloudflare 还分享了他们在提示词缓存(prompt caching)层面的效率优化方案。

原文链接:

Cloudflare Builds High-Performance Infrastructure for Running LLMs

本文来源:InfoQ