从桌面到企业:DGX 双系统搭配 NemoClaw,打造自主智能体全流程开发平台

点击查看原文>

当前人工智能正经历从“提示-响应”模式向自主系统的范式转变。

新一代 AI 系统具备持续推理、任务规划和工具调用能力,能够执行代码编写、数据分析、结果模拟并基于反馈迭代优化。这类长期运行的自主智能体(Autonomous Agents)对计算基础设施提出了新的技术要求:不仅需要高内存容量和持续计算能力,更需要本地部署的灵活性与严格的安全隔离机制。正是针对这些技术需求,英伟达在近日的 GTC 大会上推出了 DGX Spark 与 DGX Station 系统,配合开源 NemoClaw 软件栈,构成了面向企业本地环境的完整技术解决方案。

NemoClaw 开源栈:智能体运行时的技术架构

NemoClaw 是一个面向生产环境设计的开源软件栈,其核心组件 OpenShell 运行时环境作为 NVIDIA Agent Toolkit 的底层支撑,定义了智能体系统的完整安全边界。具体而言,OpenShell 通过数据访问控制规范智能体与存储系统的交互接口,借助工具调用沙箱隔离外部 API 和系统命令的执行环境,并利用策略执行引擎确保智能体行为符合预设的治理规则。该软件栈同时支持 Nemotron 系列及 Llama、Mistral 等主流开源模型的本地化部署,使企业能够在避免敏感数据外传的前提下构建自主智能体。

更为重要的是,开发者可在本地 DGX 系统完成智能体验证后,通过统一架构无缝迁移至数据中心级 AI 工厂,无需对代码架构进行任何重构。

DGX Spark:分布式桌面 AI 集群的技术特性

DGX Spark 采用大容量统一内存架构,单机即可支持百亿级参数模型的推理需求,其独特之处在于最多可将 4 台设备通过高速互联组成统一计算池,实现近似线性的性能扩展,形成桌面级的“微型数据中心”而无需传统机架基础设施的复杂部署。

这一架构使其广泛适用于金融领域的实时风险模型计算与压力测试、生物医药行业的药物分子模拟与研发周期压缩、能源系统的电网负荷预测与运营优化,以及媒体行业的实时内容生成与通信工作流。在软件生态方面,DGX Spark 预集成了 Anaconda、Docker、Ollama、vLLM、SGLang、ComfyUI 等主流开发工具,支持从原型验证到生产部署的平滑过渡。

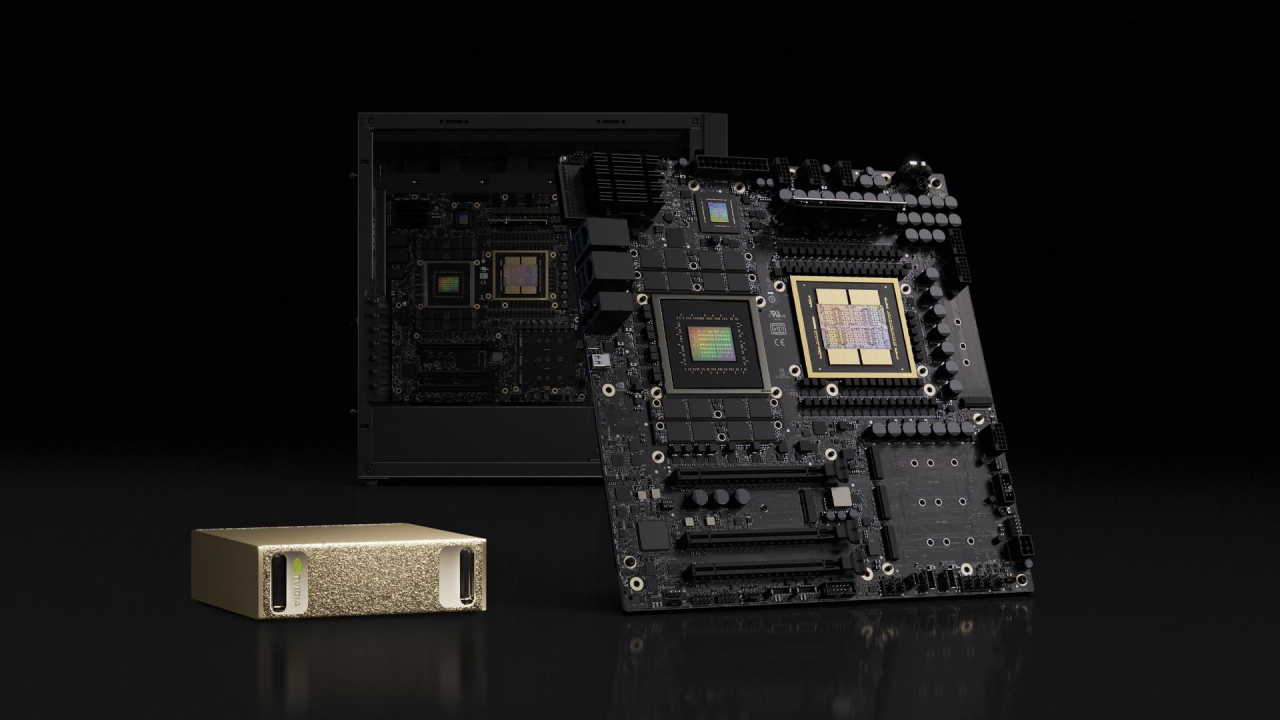

DGX Station:桌面级超级计算单元的硬件架构

DGX Station 搭载 72 核 NVIDIA Grace 处理器与 Blackwell Ultra GPU,通过 NVLink-C2C 高带宽一致性互连构建统一内存池,总容量达 748GB,可提供 20 petaflops(FP8)的 AI 算力。

这一硬件配置使其能够在本地运行万亿参数级开放模型(包括 DeepSeek-V3、Qwen3 等),并支持多步推理与复杂任务规划所需的长思考能力。

DGX Station 同时支持独立隔离部署,满足金融、医疗等受监管行业以及主权数据合规要求,且其指令集与数据中心 Grace Blackwell Ultra 机架系统完全兼容,确保应用的无缝迁移。

目前该系统已在多个行业落地:Snowflake 用于本地测试 Arctic 训练框架,EPRI 开展 AI 驱动的气象预测与电网可靠性分析,Medivis 集成视觉语言模型构建手术辅助系统,成均馆大学加速蛋白质结构分析,微软研究院与康奈尔大学则将其作为大规模 AI 实践教学平台。

DGX Spark 与 DGX Station 采用与数据中心 AI 工厂相同的 Grace Blackwell 架构,实现了软件栈的一致性——使用相同的 CUDA、TensorRT、Triton 等底层库,确保模型可移植性与开发流程的统一。

开发者可在本地完成原型验证,经部门级 Spark 集群扩展后,最终部署至企业 AI 工厂,全程无需修改代码架构。支持的模型涵盖 GPT-OSS-120B、Gemma 3、Qwen3、Kimi K2.5、Mistral Large 3、DeepSeek V3.2、Nemotron 系列等主流开放权重模型,工具链则包括 1x、Aible AI、Anaconda、Docker、红帽 OpenShift、JetBrains、Ollama、llama.cpp、ComfyUI、LM Studio、Llm.c、Weights & Biases、Odyssey、Roboflow、vLLM、SGLang、Unsloth、Learning Machine、Quali、Lightning AI 等平台。

对于技术选型,个人开发者或小型团队进行原型验证可选用单节点 DGX Station;部门级多智能体协作开发适合配置 2-4 节点的 DGX Spark 集群;受监管行业如金融、医疗、政务等场景建议采用隔离部署的 DGX Station;而有云端扩展需求的项目则可在统一架构下灵活选择任意 DGX 配置作为起点。

NVIDIA 通过 DGX Spark 与 DGX Station 将数据中心级 AI 算力下沉至桌面环境,配合 NemoClaw 开源栈提供的安全运行时,为企业构建自主 AI 智能体提供了合规、可控、可扩展的技术底座。其核心价值在于架构统一性——开发者可在本地完成全周期开发,再按需扩展至生产环境,避免重复工程投入。对于关注 AI 基础设施的技术团队而言,这一产品组合代表了企业级 AI 部署从“云端集中”向“边缘-云端协同”演进的重要技术路线。

本文来源:InfoQ