LinkedIn 整合招聘数据管道,为 AI 系统赋能

点击查看原文>

LinkedIn 推出统一集成平台,旨在标准化和打通各类分散系统中的招聘数据,提升数据质量、加快合作伙伴接入效率,并为下游 AI 应用提供底层支持。这项历时多年的布局把原本碎片化的招聘数据链路整合为统一且可扩展的底座,全面赋能各类人才产品与 AI 智能功能。

LinkedIn 的招聘业务体量庞大,需要从申请人追踪系统(ATS)、招聘网站及求职平台等多个渠道采集数据。这些数据来源往往存在数据格式不统一、信息记录残缺等问题,给下游数据分析和产品功能落地带来了不小挑战。该平台通过引入统一的数据模型和集成层来化解这一难题,实现了跨系统数据采集、协同处理与交付流程的标准化。

LinkedIn 工程负责人 Gaurav Sisodiya 在一篇帖子中阐述了其设计理念:

我们设计的目标是共存,而非替代。

据 LinkedIn 称,该平台将合作伙伴的接入时间缩短了 72%,同时扩展了数据覆盖范围并提升了数据完整性。这让外部合作伙伴与内部系统无需做自定义转换即可完成对接集成,用共享基础设施取代了此前孤立的管道。

我们开发了一个统一集成平台,用于大规模标准化、协调和交付招聘数据。

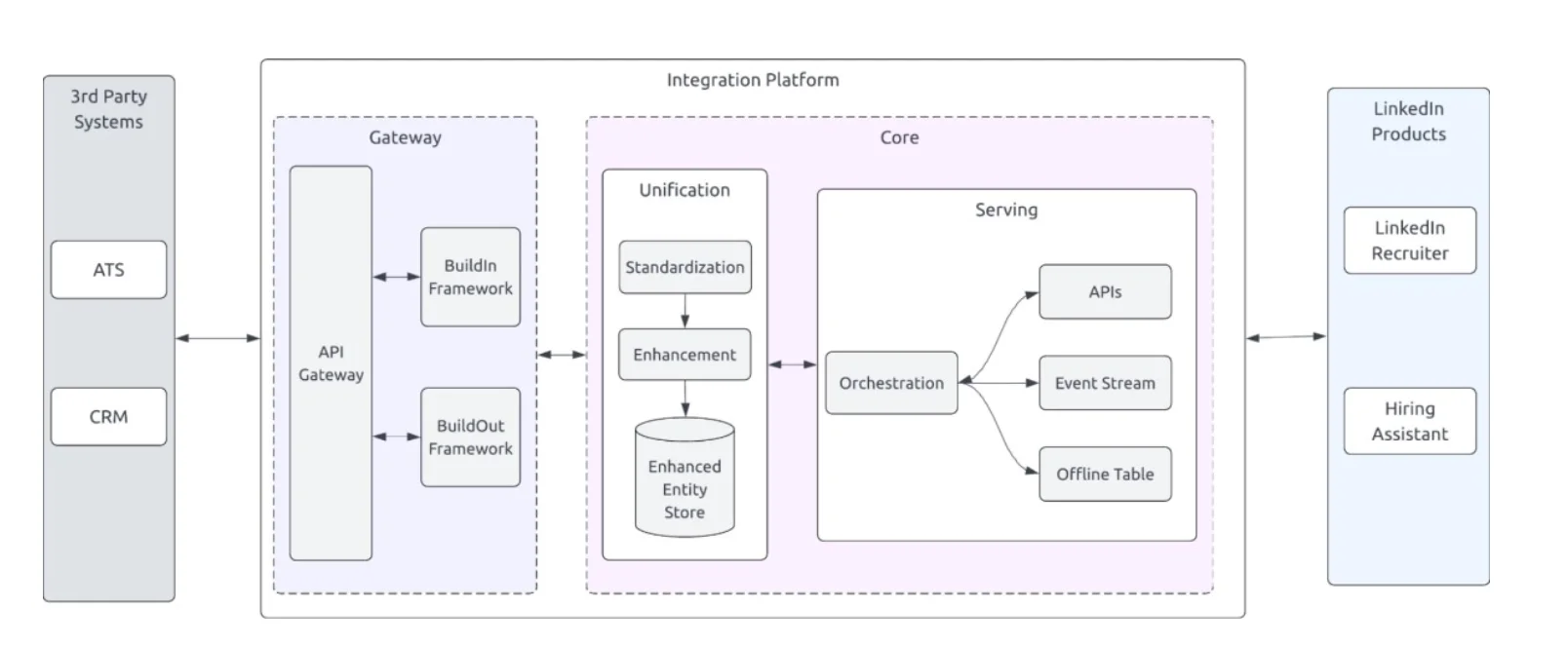

该架构分为三个层:标准化层、编排层和增强层。标准化层将来自异构来源的输入数据统一规整为标准格式,屏蔽了申请人追踪系统和求职平台之间的数据差异。编排层负责管理摄取、验证和协调工作流,协调数据流动并执行质量检查。增强层处理规整后的数据,填补缺失、去重记录、强化数据特征,然后再提供给下游系统。

高阶架构视图(来源:LinkedIn 博客文章)

LinkedIn 工程师 Aditya Hegde 在一篇帖子中介绍了底层工作流:

底层实现:Temporal 编排工作流、Kafka 数据流、Espresso 记录持久化、多模式编排,以及声明式的模式与 ID 映射,实现了可重放的双向数据同步与系统安全迭代演进。

这一结构化的数据基础让 LinkedIn 工程师能够为招聘助手(Hiring Assistant)构建感知与执行接口。标准化的招聘数据让 AI 系统可以解读候选人档案、职位要求以及招聘人员交互过程中的各种信号。该系统对信号进行聚合整理,并转化为招聘人员工作流程中的智能推荐、自动化处理与决策支持。

LinkedIn 产品经理 Ritvik Kar 强调了系统可靠性的重要性:

这一点至关重要——如果没有一个高可靠、可观测、高稳定的系统在数据读写过程中保障高可用性与一致性,我们的客户就无法信任平台,也无法顺畅开展各项工作。

LinkedIn 表示,统一平台减少了各集成数据通道间的重复构建,并通过集中化数据处理降低了维护成本。这种架构方式还提升了下游分析系统与 AI 系统的数据一致性,这些系统均依赖多个来源共享的招聘数据。

原文链接:

https://www.infoq.com/news/2026/05/linkedin-unified-hiring-platform/

本文来源:InfoQ