Pinterest 部署生产级模型上下文协议生态系统,赋能 AI 智能体工作流

点击查看原文>

Pinterest 的工程团队搭建了一个内部模型上下文协议(MCP)生态系统,用于驱动 AI 智能体,实现复杂工程任务自动化,并大规模集成各类内部工具与数据源。该架构目前已上线生产级 MCP 服务器、中心注册表以及跨开发者工具集成,将以往零散的临时对接方式替换为标准化、安全且可扩展的 AI 工具调用底层架构。MCP 让语言模型可通过统一的客户端/服务器端机制调用工具、访问结构化数据,使智能体能够执行日志分析、排查缺陷工单等任务,直接对接实时内部系统。

Pinterest 的工程师强调:

我们采用内部云托管、通过中心注册表连接多个领域专有 MCP 服务器,构建了一个灵活且安全的 AI 智能体底层架构,并将其直接融入到员工的日常工作流程中。

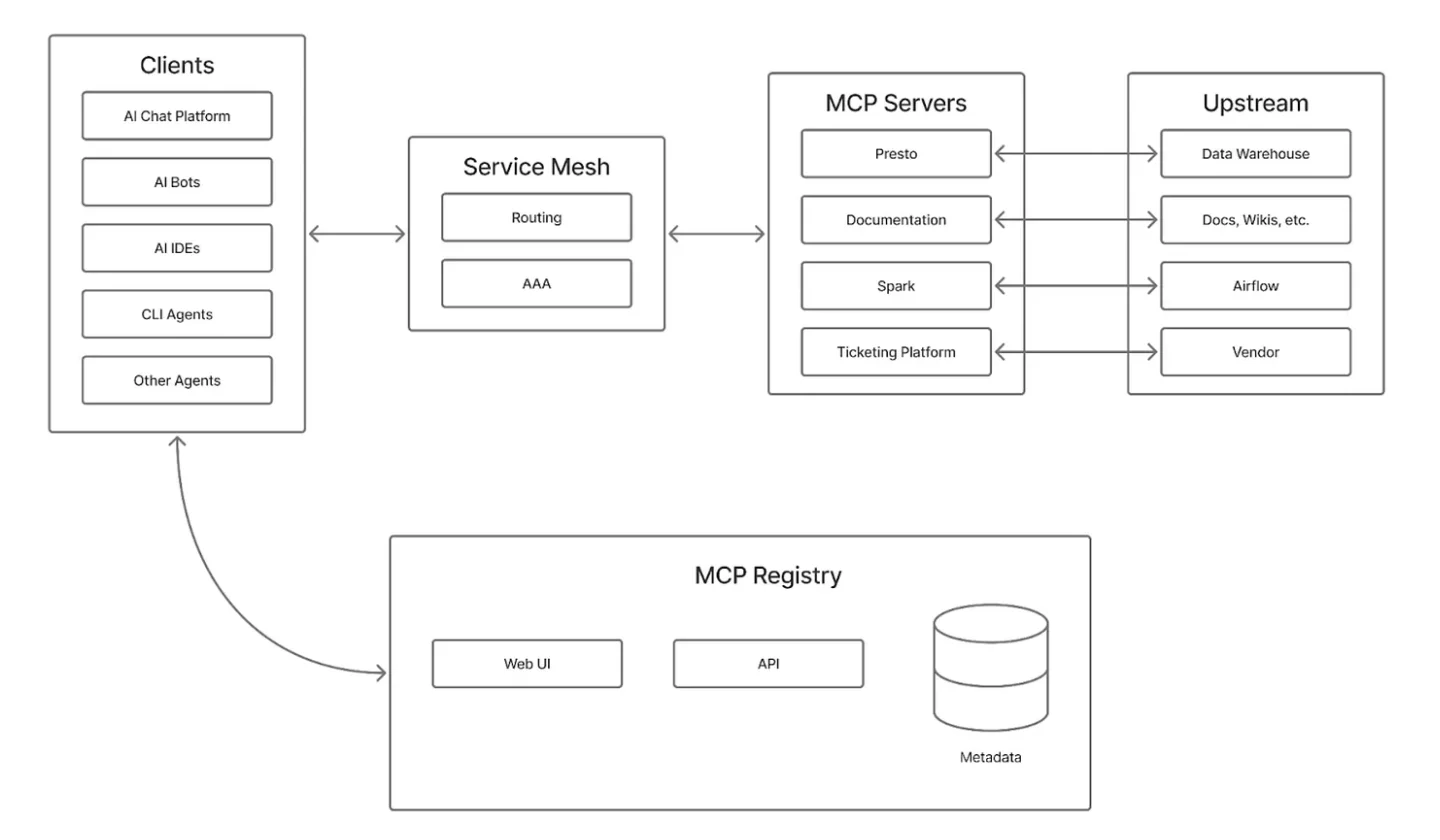

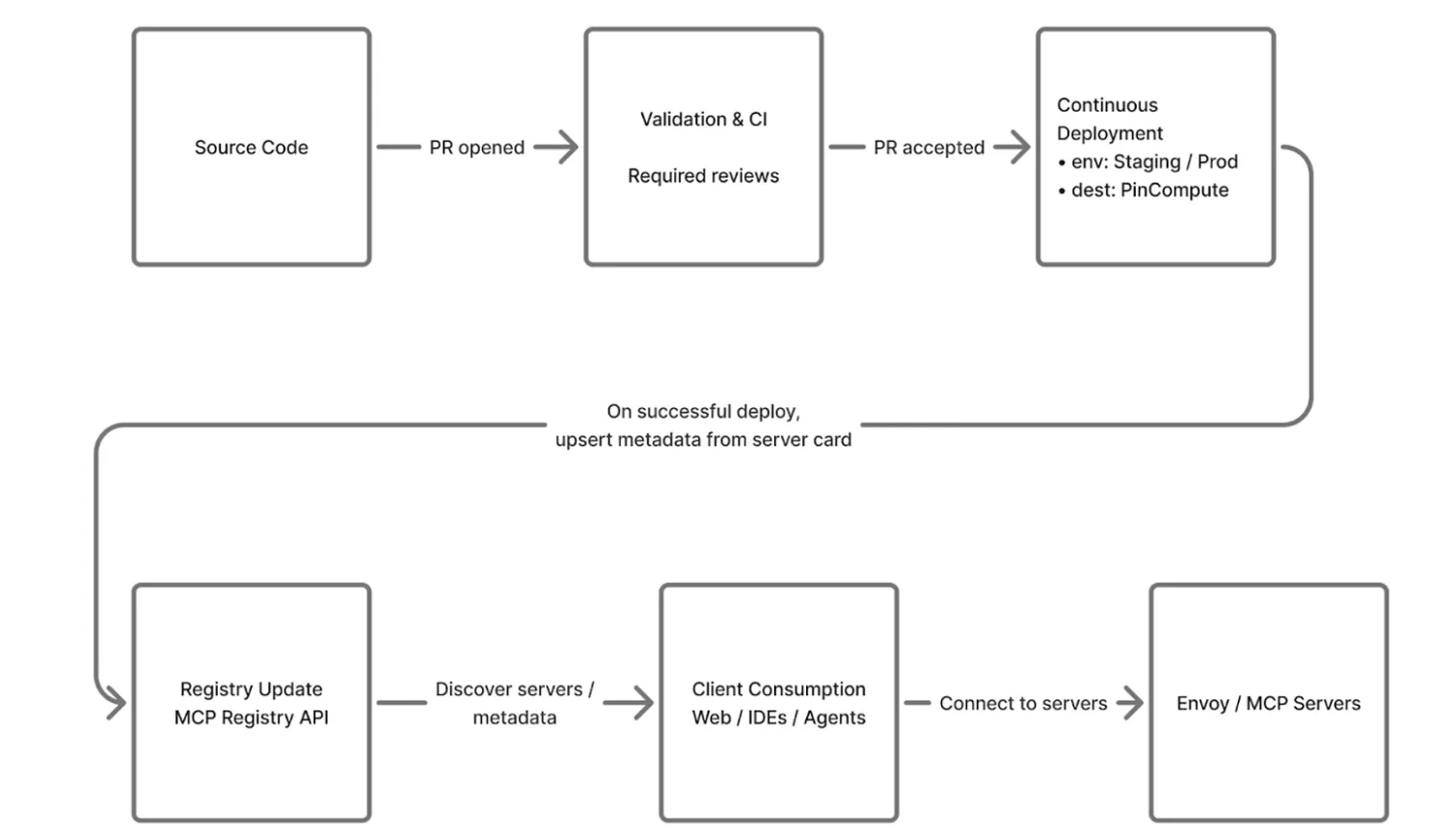

该架构的核心是一组云托管的 MCP 服务器,每个服务器均专注于特定领域(如Presto、Spark或Airflow),而非采用单一的单体服务。这种面向特定领域的设计能够有效抑制上下文膨胀,实现工具隔离,并支持细粒度的访问控制。统一的部署管道负责管理基础设施、扩缩容与服务生命周期,让工程师能够专注于工具接口的定义。

中心 MCP 注册表作为已审批服务器及其连接元数据的唯一可信数据源,提供了易用的 UI 与 API,支持服务发现、校验,并可集成至内部 AI 客户端与 IDE。客户端在调用工具前会先查询注册表,完成权限与服务器状态校验,统一执行治理策略。Pinterest 通过“节省时间”这一核心指标来衡量该生态体系的价值:工具所有者结合轻量化用户反馈及与人工流程的对比估算每次调用所节省的时间。截至 2025 年 1 月,MCP 服务器月调用量达 66000 次,覆盖 844 名活跃用户,每月可节省约 7000 工时。

Pinterest MCP 生态系统架构图(来源:Pinterest 博文)

AI 智能体工作流已集成至聊天平台与 IDE,可通过注册表发现 MCP 服务器。智能体能够自主排查事件、生成上下文摘要或提出变更建议。由于 MCP 服务器可执行自动化操作,Pinterest 要求对敏感操作进行人工审批,使用 elicitation 在执行前核验潜在风险操作。由智能体提出变更,人工在应用变更前对其进行批准或驳回。

开发 MCP 服务器的端到端流程(来源:Pinterest 博文)

安全与治理通过双层授权模型来实现,人工访问通过终端用户 JWT 来控制,服务流程则依赖服务网格身份。各服务器实现细粒度授权装饰器与业务组权限校验,将高权限操作限定在已批准的团队。OAuth 流程复用现有内部认证体系,避免额外弹窗验证,同时保证完整的可审计性。所有 MCP 服务器均需遵循 MCP 安全标准,并在投入生产前通过安全、法律/隐私及生成式 AI 相关要求审核。

这种架构思路与 AI 辅助自动化的整体发展趋势保持一致,重点在于实现对实时系统和结构化数据安全且可靠的访问,而非仅提供简单的 NLP 接口。从概念验证到建成生产就绪的生态系统这一过程为企业级 AI 自动化提供了可规模化落地的范例。Pinterest 将持续扩充 MCP 服务器集群,深化工程场景下的集成应用,优化治理模型,在严守安全与合规标准的前提下进一步提升开发者工作效率。

【声明:本文由 InfoQ 翻译,未经许可禁止转载。】

查看英文原文:https://www.infoq.com/news/2026/04/pinterest-mcp-ecosystem/

本文来源:InfoQ