一眼辨出 Deepfake!蚂蚁集团AI鉴真技术登顶世界顶会

点击查看原文>

近日,在计算机视觉顶会 CVPR 2026 NTIRE 图像检测挑战赛中,蚂蚁集团同时获得“复杂真实场景鲁棒性样本测试”赛道和“人脸增强异常检测”赛道冠军,为进一步提升 AI 时代支付、内容安全审核、金融身份认证等场景的风险识别能力提供重要支撑。

当前,深度伪造(Deepfake)与 AIGC 滥用风险加剧,不仅肉眼难辨真假,现有检测模型在面对真实场景与多模态大模型快速迭代时,准确率也出现断崖式下跌。本次 CVPR 挑战赛直击这一痛点,要求模型在“未知生成架构”与“复杂退化干扰”的双重极限考验下,保持高准确率与强鲁棒性。

蚂蚁集团以支付场景起家,将过去 20 年里积累的安全技术延续至 AI 安全领域。蚂蚁集团提出了一个基于 DINOv3 视觉基础模型的检测框架,实现了 AIGC 检测从实验室向真实场景的能力大幅提升。

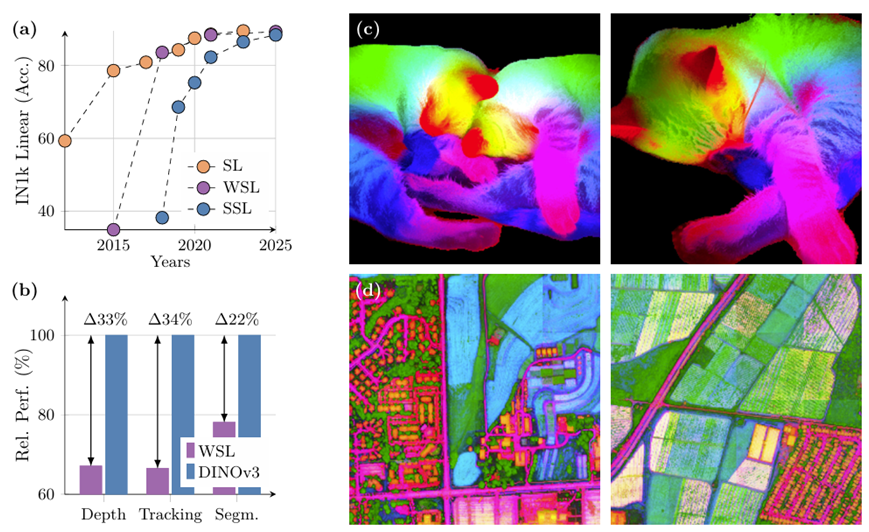

DINOv3 视觉基础模型的检测框架最初是由 Meta 发布,尝试解决大规模自监督学习中的一个核心难题:随着模型和数据规模的扩大,模型的密集特征(即像素级别的理解能力)会随训练时间的延长而退化。

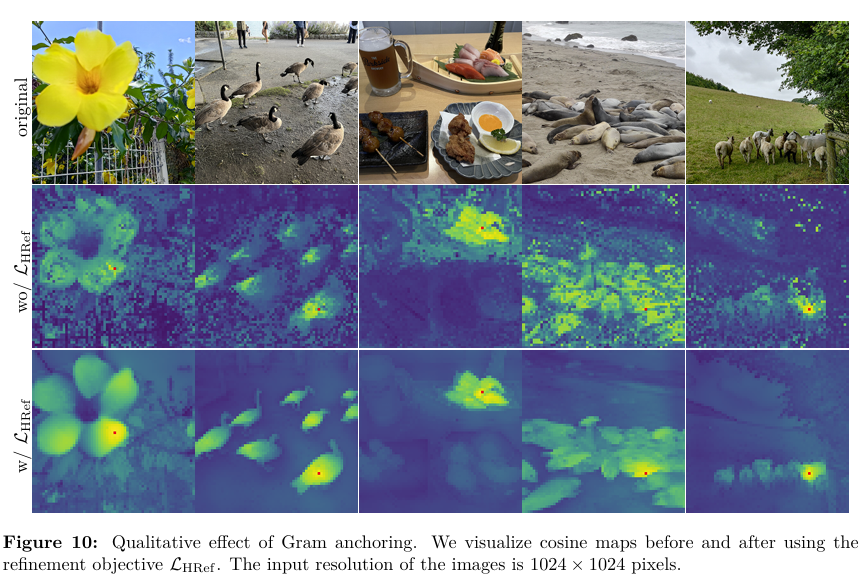

作者提出了 “Gram 锚定”(Gram Anchoring)方法,通过使用模型早期训练阶段的特征结构作为「锚点」,有效修复和提升了后期模型的密集特征质量,同时不损害其强大的全局识别能力。

结合精细的数据管理、优化的训练策略和高效的模型蒸馏,DINOv3 家族模型在无需微调(frozen backbone) 的情况下,在分割、深度估计等密集预测任务上显著超越了现有最优模型,并在分类等全局任务上达到了与顶尖弱监督模型相媲美的水平,从而树立了自监督视觉表征学习的新标杆。

DINOv3 通过采用全面的模型套件来扩展自监督学习的应用范围,以满足不同的用例需求。这包括一系列不同大小的 Vision Transformer (ViT) 和为在资源受限环境中部署而优化的高效 ConvNeXt 架构。

技术报告: [2508.10104] DINOv3

在“复杂真实场景鲁棒性样本测试”赛事,蚂蚁 AI 安全实验室参赛团队搭建了一个包含数百万高质量样本的复杂训练语料库,覆盖 WildFake、Z-Image、Seedream、Nano-banana-pro 等开源数据集和前沿模型;底层采用双流并行集成架构,如同为检测模型配备两双互补的眼睛,分别捕捉图像的局部细节与整体特征。团队模拟图像从单一噪点到多重失真的全链路退化效果,深度还原社交平台传播、二次翻拍等真实场景的图像失真特征,大大提升了模型在真实场景下的检测能力。

此外,团队还提出了“先定位可疑区域,再进行细节审查”(Locate-Then-Examine)的两阶段检测范式,并构建了提供局部区域文本解释的数据集 FakeXplained。在面对可疑图像时,该方法不仅能准确判断其是否由 AI 生成,还能在图像上定位出存在伪造瑕疵或违背物理常识的区域,并同步生成详尽的解释。该方法突破了传统“黑盒”检测的局限,让模型决策“有据可查”。

为方便技术从业者共同应对 Deepfake 挑战,团队还通过 GitHub 开源了领域内最全面的 AIGC 图像视频检测资源仓库。

GitHub 地址:https://github.com/ant-research/Awesome-AIGC-Image-Video-Detection

在“人脸增强异常检测”赛事,蚂蚁国际参赛团队凭借精准定位人脸图像异常区域的技术能力夺冠。

这项技术能够精确识别并定位人脸图像中的异常区域,主要应用于金融交易身份鉴别、开户材料审核等场景,为防范 Deepfake 深度伪造与 AIGC 攻击提供重要技术保障。在跨境支付与金融服务领域,蚂蚁国际将 AIGC 识别技术深入应用到 EKYC、凭证、材料的防伪当中,确保了对各类生成内容的检测能力。

CVPR 是 IEEE 主办的国际计算机视觉与模式识别会议,与 ICCV、ECCV 并称为计算机视觉领域的世界三大顶级会议,该挑战赛共吸引 500 多支国内外队伍参赛。

本文来源:InfoQ